คำอธิบาย

AI ROBOT ROSMASTER M3 PRO With Display

ROSMASTER M3 Pro คือแพลตฟอร์มหุ่นยนต์อัจฉริยะ AI ระดับ “Embodied Intelligence” ที่ Yahboom พัฒนาเพื่อการศึกษา และ การวิจัย โดยเฉพาะ

- ระบบหลัก: ROS2 Humble (รองรับ RViz2, Gazebo, MoveIt2, Nav2)

- แชสซี: อลูมิเนียม + ล้อ Mecanum + ระบบ Pendulum Suspension ขับเคลื่อนได้ทุกทิศทาง

- กล้อง: Binocular Structured Light Depth Camera – ใช้สำหรับ 3D Perception / Grasping

- แขนกล: 6 DOF Robotic Arm (Servo based – รองรับ MoveIt Simulation)

- เซนเซอร์: Dual TOF LiDAR (ด้านหน้าและด้านหลัง) → รองรับ SLAM Mapping + Obstacle Avoidance

สเปกและคุณสมบัติหลัก (Technical Overview)

| หมวด | รายละเอียด |

|---|---|

| 🔹 Main Control Board (เลือกได้) | Raspberry Pi5-16GB/ Jetson Nano 4GB / Jetson Orin Nano Super 8GB / Jetson Orin NX Super 8GB, 16GB |

| 🔹 โครงสร้าง (Chassis) | อลูมิเนียมอัลลอย, ล้อ Mecanum 80 mm, โครงช่วงล่างแบบ Pendulum Suspension |

| 🔹 ระบบนำทาง (Navigation) | LiDAR 2 ตัว (หน้า-ซ้าย, หลัง-ขวา) → 360° Mapping, TOF ranging |

| 🔹 กล้อง (Vision) | Depth Camera (สำหรับ 3D Mapping / Grasping) |

| 🔹 แขนกล (Manipulator) | 6 DOF Robotic Arm + MoveIt Simulation |

| 🔹 AI & Voice Perception | มีระบบ Speech Recognition + NLP พร้อม Speaker ตอบสนองแบบ Q&A |

| 🔹 ระบบ AI Model | รองรับ Multimodal Interaction (ภาพ, เสียง, ข้อความ) + RAG Knowledge System |

| 🔹 OS / Framework | ROS2 Humble + AI Toolkit + SLAM + Visual Recognition Modules |

| 🔹 Applications | ใช้สอน AI / SLAM / Robot Control / Research Projects / Competition Platform |

ความสามารถเชิงระบบ (Core Capabilities)

- รองรับการ โต้ตอบด้วยเสียง (Voice Interaction) และ ภาพ (Vision) พร้อมประมวลผลแบบเรียลไทม์

- มีโมดูล Semantic Understanding + RAG AI System สำหรับ Reasoning และ Task Awareness

- สามารถทำ 3D Grasping + MoveIt Simulation ด้วยแขนกล 6 แกน

- มีเอกสารสอน / โค้ด / ตัวอย่าง ROS2 สำหรับ มหาวิทยาลัย และ ห้องแล็บวิจัย

โมดูลการสอนและงานวิจัย (Educational Modules)

- ROS2 Basic Tutorials – Publisher / Subscriber / TF / URDF

- SLAM Mapping & Autonomous Navigation – Cartographer, Nav2

- MoveIt 2 Arm Control – Kinematics + Inverse Kinematics

- Vision Recognition + 3D Grasping – Depth Perception + Object Tracking

- Voice Interaction + AI Planning – Speech to Action Pipeline

- Multimodal Fusion – Combine Voice + Image + Text Decision

- Simulation in Gazebo / RViz – Virtual Test Environment

พัฒนาโดยใช้ระบบ ROS2 (Developed using ROS2 System)

ROS2 Humble เป็นเวอร์ชันที่เสถียรที่สุดและมีเอกสารตัวอย่าง (case tutorials) มากที่สุดในปัจจุบัน เป็นรุ่นที่ได้รับการสนับสนุนระยะยาว (LTS) และใช้งานอย่างแพร่หลายในสถาบันการศึกษาและงานวิจัย

ROS (Robot Operating System)

เป็นเฟรมเวิร์กที่ออกแบบมาเพื่อแก้ปัญหาด้านการสื่อสารและการทำงานร่วมกันระหว่างโมดูลของหุ่นยนต์ เช่น มอเตอร์ เซนเซอร์ และอัลกอริธึมควบคุม

ROS2 คือรุ่นใหม่ของ ROS ที่พัฒนาต่อจาก ROS1 — มีความสามารถมากขึ้นในด้าน:

- ความเสถียรของระบบ (Stability)

- ความปลอดภัยของการสื่อสาร (DDS Middleware)

- การประมวลผลแบบเรียลไทม์

- รองรับการทำงานแบบกระจาย (Distributed System)

- รองรับหลายภาษา เช่น Python, C++, และ AI Libraries

ข้อดีของ ROS2 Humble ที่ใช้ใน ROSMASTER M3 Pro

| คุณสมบัติ | รายละเอียด |

|---|---|

| ความเสถียรสูง (High Stability) | เหมาะกับระบบหุ่นยนต์ที่ต้องการ uptime ต่อเนื่อง เช่น การสอน/วิจัย |

| การสื่อสารแบบ DDS | ใช้ Data Distribution Service เพื่อให้ node ต่างๆ ติดต่อกันอย่างปลอดภัยและมี latency ต่ำ |

| รองรับการจำลอง (Simulation) | ใช้งานร่วมกับ Gazebo / RViz2 / MoveIt2 ได้เต็มระบบ |

| อัปเดตระยะยาว (LTS Support) | ได้รับการอัปเดตและแพตช์ความปลอดภัยต่อเนื่องจาก Open Robotics |

| เอกสารและตัวอย่างจำนวนมาก | มี Tutorials / Package / Template มากมาย ใช้สอนในมหาวิทยาลัยทั่วโลก |

เปรียบเทียบกับรุ่นใกล้เคียง (Comparison Insight)

| รุ่น | คอนโทรลบอร์ด | แขนกล | กล้อง | จุดเด่นหลัก |

|---|---|---|---|---|

| M3 Lite | Jetson Nano / Pi 4 | ไม่มี | Depth Camera เล็ก | สำหรับสอนเบื้องต้น AI SLAM |

| M3 Pro | Orin Nano / NX / Nano B01 / Pi 5 | 6 DOF | Depth Camera เต็มระบบ | รุ่น Top สุด – รองรับ AI + Voice + RAG |

| M2 Pro | Jetson Nano B01 / Pi 4 | 4 DOF | RGB Camera | เหมาะกับ AI Vision พื้นฐาน |

| X3 Pro / M5 Series | Orin NX / AGX / Pi 5 | 6 DOF ยาว + กล้อง คู่ | Industrial Research ระดับสูง |

Study Learning Resources

| รายการ | ลิงก์ |

|---|---|

| Tutorial Main Page | https://www.yahboom.net/study/ROSMASTER-M3PRO |

| GitHub Code & Package | ภายในหน้าคู่มือมีลิงก์ ไป ROS2 workspace และ Gazebo model |

| Video Demo + Setup | มีวิดีโอสอนการประกอบ / Calibration / SLAM / MoveIt บนหน้าเว็บเดียวกัน |

| PDF Manual | ROSMASTER M3 Pro User Guide – Humble Edition” (ดาวน์โหลดในหน้าเดียวกัน |

แนะนำให้เลือกรุ่นที่ใช้บอร์ด Jetson Orin Nano SUPER หรือ Jetson Orin NX SUPER เพื่อให้การทำงานของโมเดล AI ขนาดใหญ่ (Large Model / LLM + Vision) เป็นไปอย่างลื่นไหล และสามารถแสดงศักยภาพของฟังก์ชันขั้นสูงได้ครบถ้วน เช่น การรู้จำภาพ 3D, การสนทนาด้วยเสียง, และการประมวลผลแบบ Multimodal

- Jeston Orin NANO SUPER-8GB With Display

- Jeston Orin NX SUPER-8GB With Display

- Jeston Orin NX SUPER-16GB With Display

เปรียบเทียบบอร์ดที่รองรับ

| รุ่นบอร์ด | GPU / CUDA Core | RAM | AI Performance | เหมาะสำหรับ | หมายเหตุ |

|---|---|---|---|---|---|

| Raspberry Pi 5 | CPU-only (Broadcom BCM2712) | 8 GB | ต่ำ | การสอน ROS2 พื้นฐาน | ไม่เหมาะกับ Vision/LLM |

| Jetson Nano B01 | 128 CUDA cores | 4 GB | 0.5 TFLOPS | AI พื้นฐาน, SLAM, Vision | มี Lag หากใช้ Voice/LLM |

| Jetson Orin Nano SUPER | 1024 CUDA + 32 Tensor cores | 8 GB | 40 TOPS | AI/SLAM/Voice/3D Vision | แนะนำ |

| Jetson Orin NX SUPER | 1024 CUDA + 32 Tensor cores | 16 GB | 70 TOPS | งานวิจัยระดับสูง, RAG, LLM | แนะนำที่สุด |

- ถ้าเน้น AI, Voice Interaction, SLAM, Grasping, 3D Vision → ใช้ Orin NX SUPER

- ถ้าใช้เพื่อ สอน ROS2 / SLAM พื้นฐาน / AI Demo → ใช้ Orin Nano SUPER ก็เพียงพอ

รหัสสินค้า 5 รุ่นย่อย

- RB-M3P-PI5-16G-D Controller Raspberry Pi 5 RAM 16GB + Display

- RB-M3P-JN-4G-D Controller Jetson Nano B01 RAM 4GB + Display

- RB-M3P-ONNS-8G-D Controller Jetson Orin Nano SUPER RAM 8GB + Display

- RB-M3P-ONXS-8G-D Controller Jetson Orin NX SUPER RAM 8GB + Display

- RB-M3P-ONXS-16G-D Controller Jetson Orin NX SUPER RAM 16GB + Display

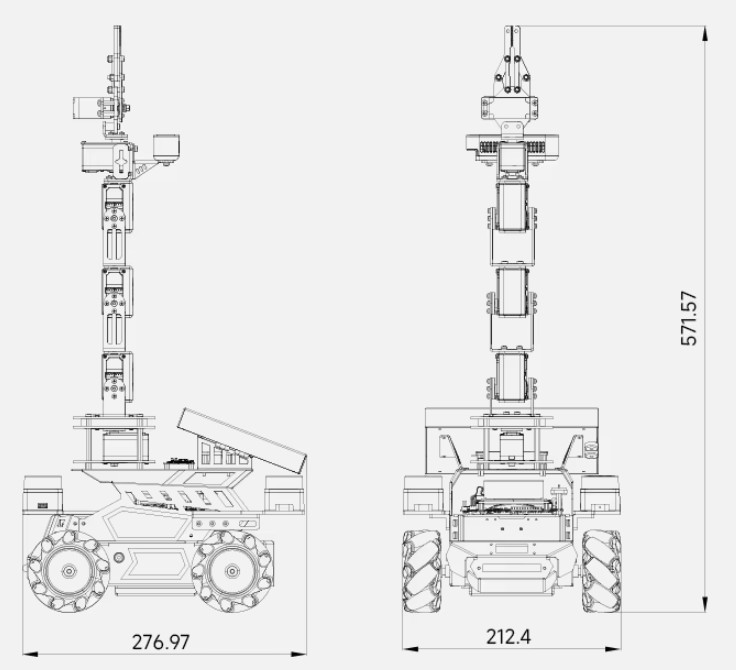

Dimension mm

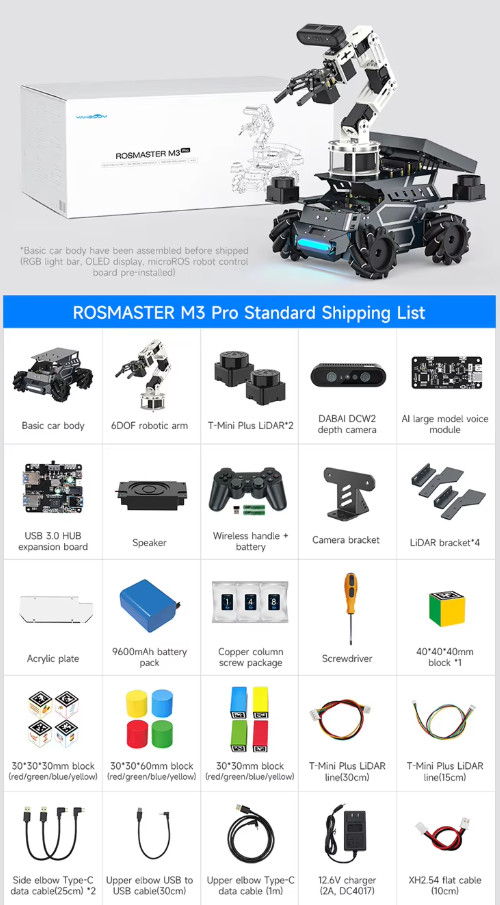

Shipping List

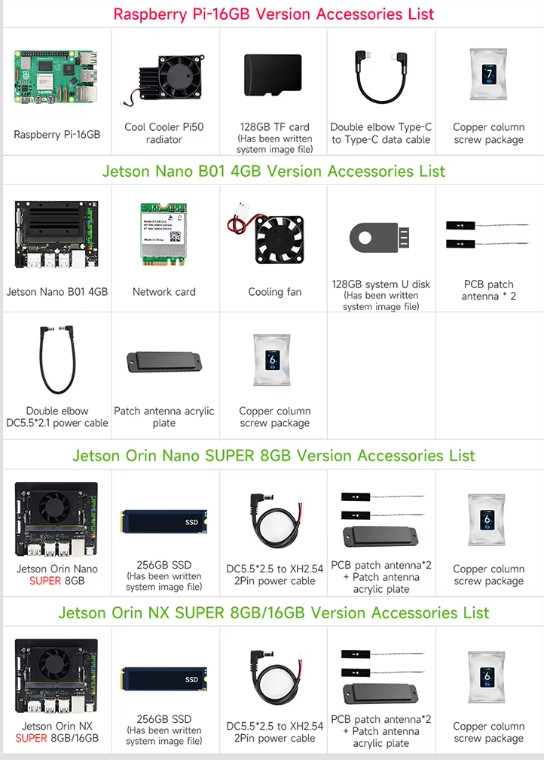

Option Controller

Option Display

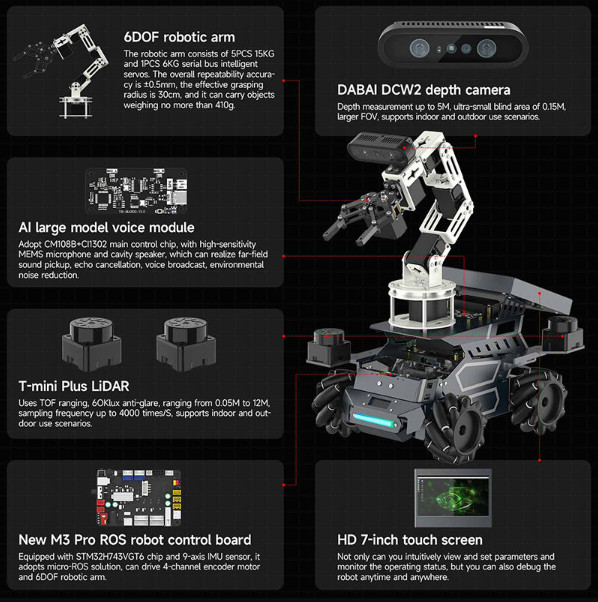

ภาพรวมระบบเต็ม

ROSMASTER M3 Pro – สรุปองค์ประกอบฮาร์ดแวร์

🔹 แขนกลหุ่นยนต์ 6 แกน (6DOF Robotic Arm)

แขนกลประกอบด้วยเซอร์โวมอเตอร์อัจฉริยะ 6 ตัว (5 ตัวแรงบิด 15 กิโลกรัม และ 1 ตัวแรงบิด 6 กิโลกรัม)

ให้ความแม่นยำในการทำซ้ำสูงถึง ±0.5 มิลลิเมตร

มีรัศมีการหยิบจับสูงสุด 50 เซนติเมตร

สามารถยกวัตถุที่มีน้ำหนักไม่เกิน 410 กรัม ได้อย่างมั่นคง

🔹 กล้องวัดระยะเชิงลึก DABAI DCW2

วัดระยะได้ไกลถึง 5 เมตร

พื้นที่บอด (Blind Zone) เพียง 0.15 เมตร

มุมมองภาพกว้าง (FOV สูง) เหมาะกับการใช้งานทั้งในอาคารและนอกอาคาร

รองรับการสร้างภาพ 3 มิติ (3D Vision), การหยิบจับด้วยแขนกล และงานด้าน AI Vision

🔹 โมดูลเสียงอัจฉริยะ (AI Large Model Voice Module)

ใช้ชิปควบคุมหลัก CM108B + CT1302

พร้อมไมโครโฟน MEMS ความไวสูงและลำโพงภายในตัว

รองรับการจับเสียงระยะไกล (Far-field), ตัดเสียงสะท้อน, ลดเสียงรบกวน

และสามารถโต้ตอบด้วยเสียงกับระบบ AI ได้แบบเรียลไทม์

🔹 เซนเซอร์เลเซอร์วัดระยะ T-mini Plus LiDAR

ใช้เทคโนโลยี TOF (Time of Flight) ทนแสงสูงถึง 60 klux

สามารถวัดระยะได้ตั้งแต่ 0.05 – 12 เมตร

อัตราการสแกนสูงถึง 4,000 ครั้งต่อวินาที

รองรับการทำแผนที่ (SLAM), การหลบสิ่งกีดขวาง และการนำทางอัตโนมัติทั้งในและนอกอาคาร

🔹 ระบบ AI ขนาดใหญ่ 3 รูปแบบ (Built-in Three AI Large Models)

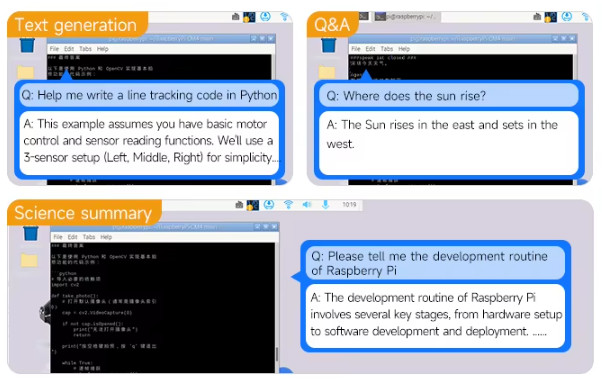

01. Large Language Model – โมเดลภาษาขนาดใหญ่

ROSMASTER M3 Pro เชื่อมต่อกับแพลตฟอร์มโมเดลภาษาขนาดใหญ่แบบเรียลไทม์ ทำหน้าที่เป็น “สมองหลัก (Super Brain)” ที่สามารถ

- เข้าใจคำสั่งจากข้อความ (Text Command)

- สร้างคำตอบอัตโนมัติอย่างยืดหยุ่น

- ประมวลผลข้อมูลเชิงตรรกะและเนื้อหาทางวิทยาศาสตร์ได้

ตัวอย่างการทำงานของระบบ AI ภาษาขนาดใหญ่:

- Text Generation: สร้างโค้ดหรือเนื้อหาตามคำสั่ง เช่น “ช่วยเขียนโปรแกรม Line Tracking ด้วย Python”

- Q&A: ตอบคำถามทั่วไป เช่น “พระอาทิตย์ขึ้นทางทิศไหน”

- Science Summary: สรุปเนื้อหาทางวิทยาศาสตร์ เช่น “ขั้นตอนการพัฒนา Raspberry Pi”

02. Voice Large Model – โมเดลเสียงอัจฉริยะ

ROSMASTER M3 Pro มาพร้อม โมดูลเสียง AI ขนาดใหญ่ (AI Voice Model Module) และลำโพงในตัว

สามารถแปลงเสียง ↔ ข้อความได้แบบเรียลไทม์

เมื่อต่อกับโมเดล AI จะสามารถ “ฟัง” และ “พูด” ได้เสมือนผู้ช่วยอัจฉริยะจริง

ตัวอย่าง:

เมื่อผู้ใช้พูดว่า “Hi Yahboom, Tell me a story”

ระบบจะตอบกลับด้วยเรื่องเล่าเสียงพูดแบบธรรมชาติ พร้อมเนื้อหาที่ AI สร้างขึ้นเอง

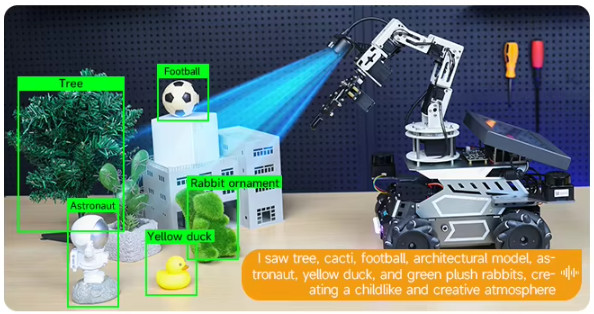

03. Visual Large Model – โมเดลการมองเห็นอัจฉริยะ

ติดตั้ง กล้องตรวจจับเชิงลึก DABAIDCW2 Depth Camera

สามารถเข้าใจและวิเคราะห์ภาพได้แบบเรียลไทม์ โดยใช้เทคโนโลยี AI Vision ขนาดใหญ่

ฟังก์ชันหลัก:

- วิเคราะห์และระบุวัตถุในภาพอย่างแม่นยำ (Object Recognition)

- เข้าใจฉากและสภาพแวดล้อม (Scene Understanding)

- ให้ผลลัพธ์เป็นทั้ง “ข้อความ” และ “เสียง” แบบโต้ตอบ

ตัวอย่าง:

AI จะตรวจจับวัตถุ เช่น ต้นไม้ ลูกฟุตบอล กระต่ายจำลอง เป็ดสีเหลือง นักบินอวกาศ และแบบจำลองอาคาร

พร้อมสรุปเสียงตอบกลับว่า

“I saw tree, cacti, football, architectural model, astronaut, yellow duck, and green plush rabbits…”

การประยุกต์ใช้งานเชิงสร้างสรรค์ของโมเดลการมองเห็นหลายมิติ (Creative Application of Multi-modal Visual Model)

ROSMASTER M3 Pro สามารถรับรู้สภาพแวดล้อมรอบตัวได้อย่างแม่นยำด้วยโครงสร้างฮาร์ดแวร์ประสิทธิภาพสูง

โดยผสานการทำงานของ โมเดล AI ขนาดใหญ่แบบหลายมิติ (Multi-modal Large Model)

และ สถาปัตยกรรมตรรกะสองชั้น (Dual-Model Reasoning Architecture)

ทำให้หุ่นยนต์สามารถ

- เข้าใจสภาพแวดล้อม

- วางแผนการทำงานอย่างยืดหยุ่น

- ประสานงานระหว่าง “คนกับหุ่นยนต์” (Human–Machine Collaboration) ได้อย่างเป็นธรรมชาติและมีประสิทธิภาพมากขึ้น

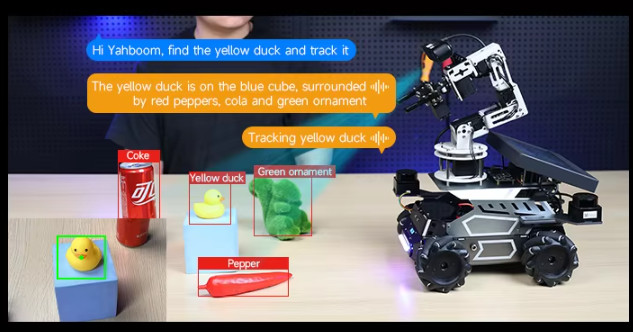

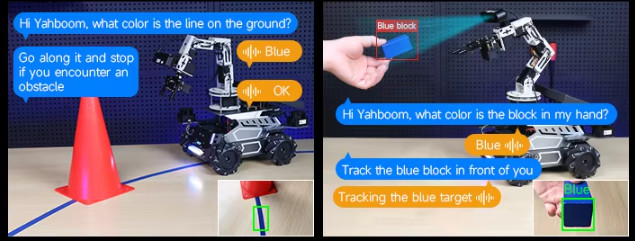

01. การติดตามด้วยการมองเห็น (Visual Tracking)

ด้วยพลังการประมวลผลจากโมเดลภาพขนาดใหญ่ ROSMASTER M3 Pro

สามารถระบุและติดตามวัตถุเป้าหมายได้แบบเรียลไทม์

แม้อยู่ในสภาพแวดล้อมที่ซับซ้อน

ตัวอย่าง:

“Hi Yahboom, find the yellow duck and track it.”

ระบบจะตรวจพบ “เป็ดสีเหลืองบนบล็อกสีน้ำเงิน” และทำการติดตามทันที

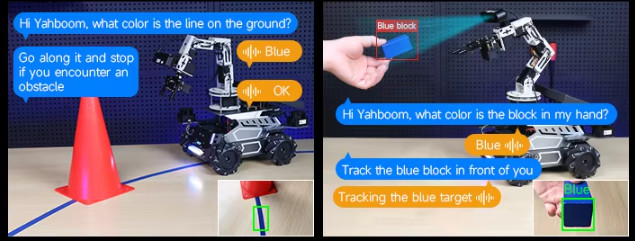

02. การเคลื่อนที่อัตโนมัติ (Autonomous Cruising)

ด้วยความเข้าใจเชิงความหมาย (Semantic Understanding)

หุ่นยนต์สามารถระบุวัตถุ เช่น กรวยจราจร หรือสิ่งกีดขวางในเส้นทาง

พร้อมปรับเส้นทางเคลื่อนที่โดยอัตโนมัติได้

ตัวอย่าง:

“Hi Yahboom, what color is the cone on the ground?”

ระบบตอบ: “Go along at 30° to the right if you encounter an obstacle.”

03. การติดตามด้วยสี (Color Tracking)

โมเดลการมองเห็นของ M3 Pro สามารถวิเคราะห์และติดตามวัตถุจากสีภายในระยะมองเห็น

โดยใช้ อัลกอริทึม KCF + PID เพื่อให้การติดตามมีความแม่นยำสูง

ตัวอย่าง:

“Hi Yahboom, what color is the block in my hand?”

ระบบตอบ: “The block is blue. Tracking the blue target.”

การประยุกต์ใช้งานระบบปัญญาเชิงกายภาพ (Embodied Intelligence Applications)

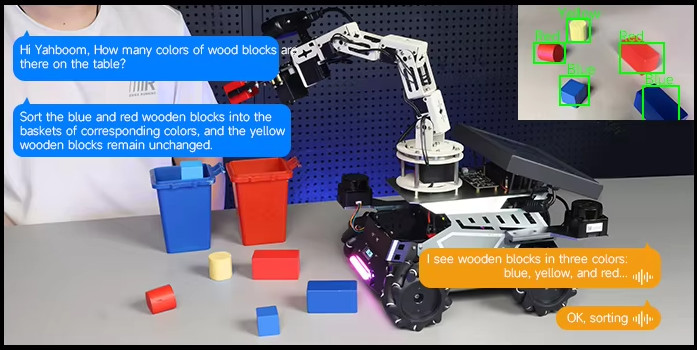

01. การคัดแยกวัตถุอัจฉริยะ (Embodied Intelligent Sorting)

ROSMASTER M3 Pro สามารถตรวจจับและจำแนกวัตถุภายในขอบเขตการมองเห็นได้อย่างแม่นยำ

พร้อมตัดสินใจเคลื่อนไหวตามคำสั่งเสียงของผู้ใช้ เพื่อจัดเรียงหรือคัดแยกวัตถุโดยอัตโนมัติ

ตัวอย่าง:

“Hi Yahboom, how many colors of wood blocks are there on the table?”

ระบบตอบกลับ “I see wooden blocks in three colors: blue, yellow, and red.”

จากนั้นจะดำเนินการคัดแยกบล็อกสีน้ำเงินและสีแดงใส่ถังตามสีที่กำหนด

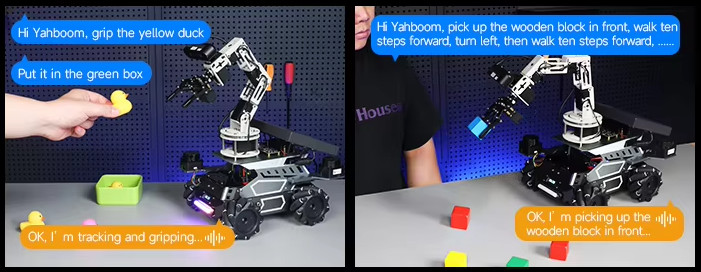

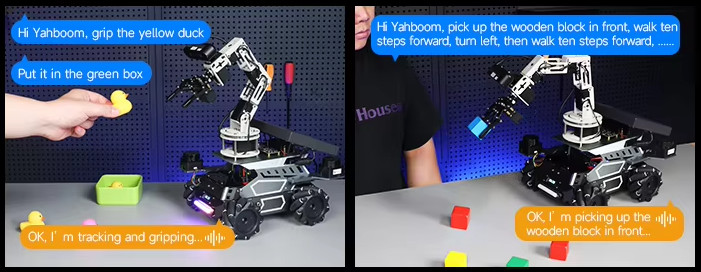

02. การติดตามและหยิบจับวัตถุอัจฉริยะ (Embodied Intelligent Tracking & Gripping)

M3 Pro สามารถติดตามวัตถุที่กำลังเคลื่อนที่ได้แบบเรียลไทม์

และใช้แขนกล 6 แกนในการหยิบวัตถุ จากนั้นวางลงในตำแหน่งที่ระบุไว้ตามคำสั่งเสียงของผู้ใช้

ตัวอย่าง:

“Hi Yahboom, grip the yellow duck.”

ระบบตอบกลับ “OK, I’m tracking and gripping.”

จากนั้นจะหยิบวัตถุแล้ววางลงในกล่องสีเขียวอัตโนมัติ

03. การขนย้ายวัตถุอัจฉริยะ (Embodied Intelligent Handling)

M3 Pro สามารถแยกวิเคราะห์คำสั่งเสียงที่ซับซ้อน

และดำเนินการขนย้ายวัตถุในเส้นทางหลายทิศทางได้อย่างแม่นยำ

แสดงให้เห็นถึงความสามารถของ AI เชิงปฏิบัติ (Embodied AI)

ที่ผสานการเข้าใจสภาพแวดล้อมกับการทำงานอัตโนมัติระดับสูง

ตัวอย่าง:

“Hi Yahboom, pick up the wooden block in front, walk ten steps forward, turn left, then walk ten steps forward.”

ระบบตอบกลับ “OK, I’m picking up the wooden block in front.”

และดำเนินการขนย้ายวัตถุตามเส้นทางที่กำหนดได้อย่างถูกต้อง

การนำทางอัจฉริยะและการรับรู้สิ่งแวดล้อม (Embodied Intelligent SLAM Navigation & Environmental Perception)

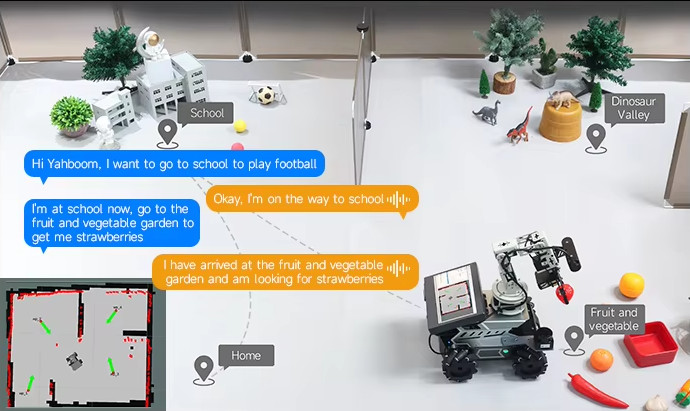

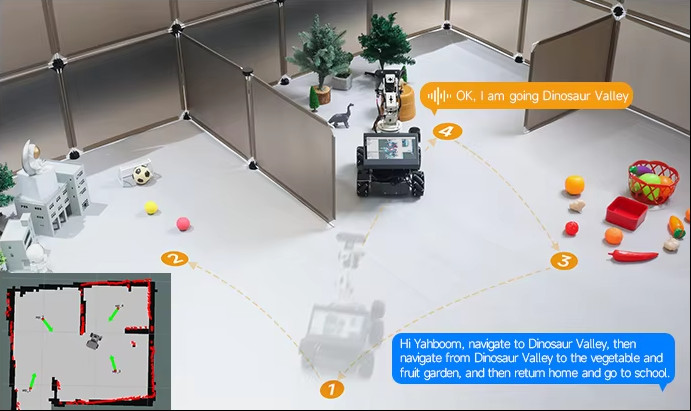

01. การนำทางอัจฉริยะด้วยระบบหลายจุด (Intelligent Multi-point Navigation)

ROSMASTER M3 Pro สามารถส่งข้อมูลสภาพแวดล้อมแบบเรียลไทม์เข้าสู่ โมเดลการมองเห็น AI ขนาดใหญ่ (Visual Large Model)

เพื่อทำการวิเคราะห์เชิงลึกและวางเส้นทางการเคลื่อนที่แบบไดนามิกตามคำสั่งเสียงของผู้ใช้ได้โดยอัตโนมัติ

ระบบสามารถ

-

เดินทางไปยังตำแหน่งที่กำหนดหนึ่งหรือหลายจุดได้ (Single / Multi-Point)

-

วางแผนเส้นทางอย่างชาญฉลาดตามสถานการณ์จริง

-

ใช้เทคโนโลยี SLAM (Simultaneous Localization and Mapping) เพื่อสร้างแผนที่และระบุตำแหน่งของตนเอง

ตัวอย่าง:

“Hi Yahboom, navigate to Dinosaur Valley, then to the vegetable and fruit garden, and finally return home.”

ระบบจะตอบ “OK, I am going to Dinosaur Valley.”

และเริ่มการนำทางตามลำดับที่กำหนดอย่างแม่นยำ

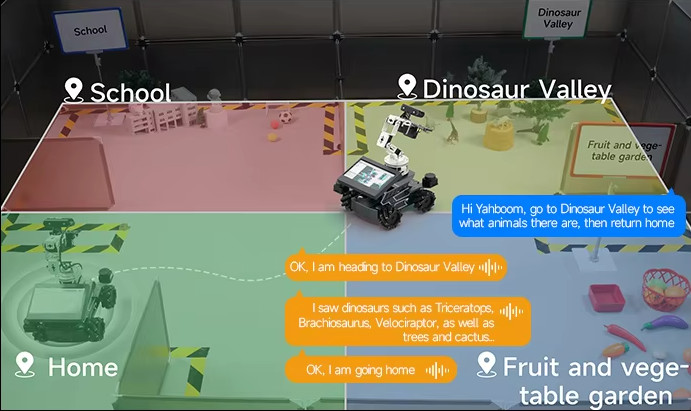

02. การรับรู้สภาพแวดล้อม (Environmental Perception)

ผ่านการวิเคราะห์ภาพด้วยโมเดลการมองเห็นขนาดใหญ่ ROSMASTER M3 Pro

สามารถเข้าใจตำแหน่งวัตถุและโครงสร้างพื้นที่ในแต่ละโซนของแผนที่ได้อย่างลึกซึ้ง

ตัวอย่าง:

“Hi Yahboom, go to Dinosaur Valley to see what animals are there, then return home.”

ระบบจะตอบ:

“OK, I am heading to Dinosaur Valley.”

“I saw dinosaurs such as Triceratops, Brachiosaurus, and Velociraptor, as well as trees and cactus.”

“OK, I am going home.”

ระบบนี้ช่วยให้หุ่นยนต์สามารถรับรู้พื้นที่จำลองเช่น School, Home, Dinosaur Valley, Fruit & Vegetable Garden

และเคลื่อนที่โต้ตอบกับผู้ใช้อย่างเป็นธรรมชาติ — สาธิตการทำงานของ AI หุ่นยนต์ระดับสูงด้าน การรับรู้และนำทางเชิงกายภาพ (Embodied SLAM-AI Integration)

การนำทางอัจฉริยะและการรับรู้สิ่งแวดล้อม (Embodied Intelligent SLAM Navigation & Environmental Perception)

01. ระบบ AI ขนาดใหญ่ + การนำทางด้วยแผนที่ SLAM (AI Large Model + SLAM Map Navigation & Transportation)

ROSMASTER M3 Pro ผสานเทคโนโลยี AI ขนาดใหญ่แบบหลายมิติ (Multimodal Large Model)

เข้ากับระบบนำทางแบบ SLAM (Simultaneous Localization and Mapping)

เพื่อให้หุ่นยนต์สามารถเข้าใจคำสั่งเสียงของผู้ใช้และเคลื่อนที่ระหว่างหลายจุด (Multi-point Navigation) ได้อย่างชาญฉลาด

เมื่อถึงตำแหน่งที่กำหนด หุ่นยนต์จะสามารถ

- วิเคราะห์สภาพแวดล้อมและสิ่งของรอบตัวผ่านโมเดลภาพ (Visual Model)

- ใช้แขนกล 6 แกน (6-DOF Arm) จัดการวัตถุเป้าหมาย เช่น การหยิบและขนย้าย

- ปรับเปลี่ยนการทำงานได้ตามบริบทจริงของสภาพแวดล้อม

ตัวอย่าง:

“Hi Yahboom, I want to go to school to play football.”

ระบบตอบ: “Okay, I’m on the way to school.”

หลังจากนั้น: “I have arrived at the fruit and vegetable garden and am looking for strawberries.”

แสดงให้เห็นถึงการทำงานร่วมกันของ AI + SLAM + Manipulation อย่างสมบูรณ์ในระดับปฏิบัติจริง

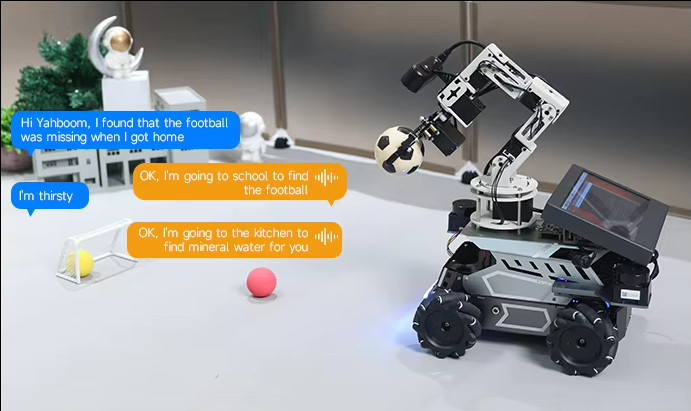

02. การเข้าใจเจตนาและการตอบสนองตามบริบท (Large Model Intention Understanding & Context-aware Response)

ด้วยการขยายฐานความรู้แบบ RAG Knowledge Base, ROSMASTER M3 Pro

สามารถวิเคราะห์ “เจตนาของผู้ใช้ (User Intention)” และ “บริบทของสภาพแวดล้อม (Context Analysis)”

เพื่อวางแผนการทำงานด้วยตนเองโดยไม่ต้องรอคำสั่งละเอียดจากผู้ใช้

ตัวอย่าง:

ผู้ใช้พูดว่า: “Hi Yahboom, I found that the football was missing when I got home.”

ระบบตอบกลับ: “OK, I’m going to school to find the football.”

หรือเมื่อผู้ใช้พูดว่า: “I’m thirsty.”

ระบบตอบ: “OK, I’m going to the kitchen to find mineral water for you.”

คุณสมบัตินี้แสดงถึงระดับความเข้าใจเชิงบริบทของหุ่นยนต์ (Context-aware AI)

ที่สามารถคาดการณ์ความต้องการของผู้ใช้ และตัดสินใจวางแผนการทำงานอย่างอิสระในสภาพแวดล้อมจำลอง

นวัตกรรมเทคโนโลยีปัญญาเชิงกายภาพ (Embodied Intelligence Technology Innovation)

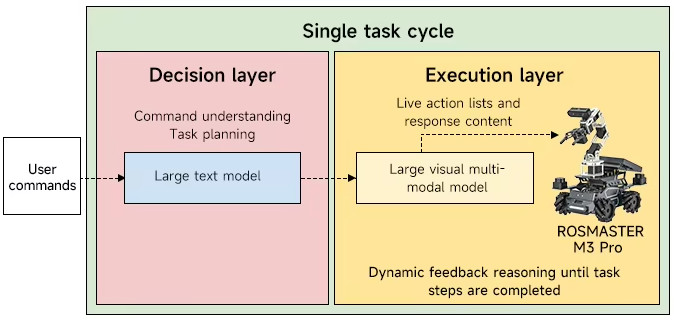

Innovation 1 – สถาปัตยกรรมการให้เหตุผลแบบสองชั้น (Dual-Model Reasoning Architecture)

ROSMASTER M3 Pro ใช้โครงสร้างการประมวลผลแบบ สองโมเดลร่วม (Dual-Model System)

ประกอบด้วย

- Decision Layer (ชั้นการตัดสินใจ) – ทำหน้าที่เข้าใจคำสั่งของผู้ใช้และวางแผนการทำงานผ่าน Large Language Model (LLM)

- Execution Layer (ชั้นการปฏิบัติ) – ใช้ Visual Multi-Modal Model เพื่อสร้างรายการการกระทำจริงและดำเนินการในสภาพแวดล้อมจริง

กระบวนการนี้มี การให้เหตุผลแบบ Feedback Loop แบบไดนามิก (Dynamic Feedback Reasoning)

ที่ปรับปรุงผลลัพธ์อย่างต่อเนื่องจนกว่างานจะสำเร็จ

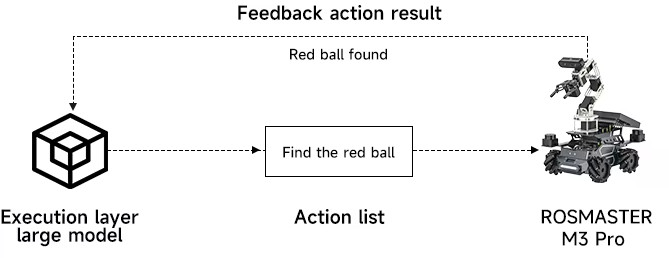

Innovation 2 – การให้เหตุผลแบบไดนามิก (Dynamic Feedback Reasoning)

ระบบ Feedback เชิงไดนามิกจะใช้ผลลัพธ์ที่ได้จากการทำงานแต่ละขั้น เพื่อปรับเปลี่ยนการกระทำถัดไปแบบเรียลไทม์

เช่น เมื่อตรวจพบลูกบอลสีแดง (Red Ball Found) ระบบจะอัปเดตการตัดสินใจใหม่อัตโนมัติ

เทคโนโลยีนี้ช่วยให้หุ่นยนต์

- ปรับตัวตามสภาพแวดล้อมจริง

- ลดความผิดพลาดระหว่างภารกิจ

- เพิ่มความแม่นยำและอัตราความสำเร็จของงาน

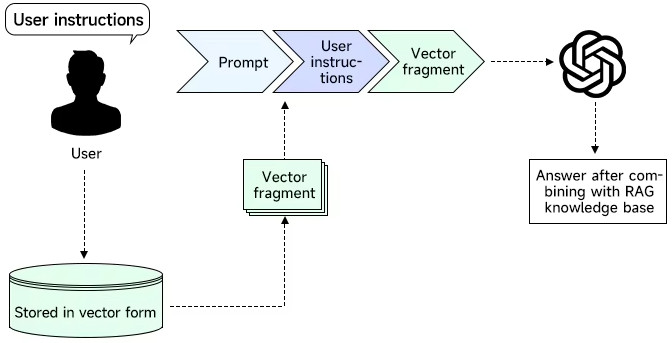

Innovation 3 – การเสริมประสิทธิภาพการดึงข้อมูลด้วย RAG (Large Model RAG Retrieval Enhancement)

RAG (Retrieval-Augmented Generation) คือสถาปัตยกรรมที่ผสาน “ระบบค้นคืนข้อมูล” เข้ากับ “ระบบสร้างผลลัพธ์”

ช่วยลดปัญหา “ข้อมูลหลอน (Hallucination)” ที่มักเกิดจากโมเดล AI ขนาดใหญ่

ใน ROSMASTER M3 Pro, ฐานความรู้ RAG ถูกตั้งค่ามาพร้อมข้อมูลจากโรงงาน

เช่น ตัวอย่างการฝึก (Training Samples) และคลังคำสั่งมาตรฐาน

พร้อมรองรับการปรับแต่งเฉพาะ (Customized Knowledge)

เพื่อให้หุ่นยนต์เรียนรู้บริบทและตอบสนองได้ตรงความต้องการของผู้ใช้มากขึ้น

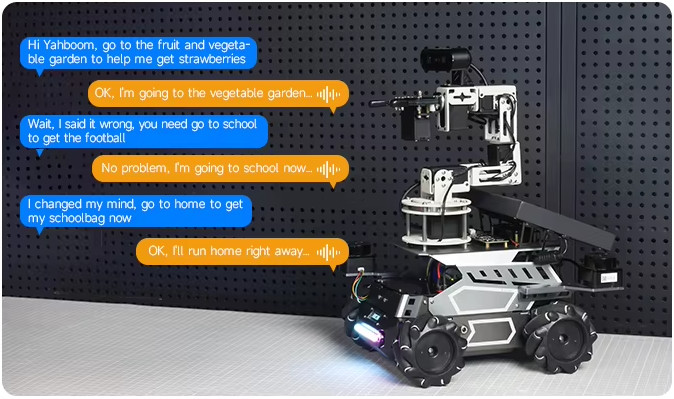

Innovation 4 – การสนับสนุนการสนทนาแบบขัดจังหวะได้ (Support Free Conversation Interruption)

ระบบสนทนาแบบต่อเนื่อง (Continuous Dialogue) ของ M3 Pro

สามารถ “ขัดจังหวะ” หรือ “เปลี่ยนคำสั่งกลางทาง” ได้แบบเรียลไทม์

ตัวอย่าง:

“Hi Yahboom, go to the fruit and vegetable garden to get strawberries.”

(ระหว่างเดินทาง) ผู้ใช้พูดว่า “Wait, I said it wrong — go get the football.”

ระบบจะตอบ “No problem, I’m going to school now.”

หรือเมื่อพูดว่า “I changed my mind, go home.”

ระบบจะตอบ “OK, I’ll run home right away.”

คุณสมบัตินี้ช่วยเพิ่มความยืดหยุ่นและความสะดวกในการสื่อสารกับหุ่นยนต์ในสถานการณ์จริง

รีวิว

ยังไม่มีบทวิจารณ์